Depuis cette nuit, Apple essaie de circonscrire l'incendie parti il y a quelques jours d'un article du Guardian sur l'écoute humaine d'extraits audio de Siri. Emboîtant le pas de Google, la Pomme a annoncé la suspension provisoire des écoutes.

Mais dans ce domaine, Apple est à la traîne par rapport à la concurrence : aussi bien Google qu'Amazon proposent de désactiver les enregistrements vocaux (lire : Et si Apple s'inspirait de Google en matière de confidentialité ?). La Pomme promet toutefois une option qui permettra aux utilisateurs de ne pas participer à ces écoutes.

En attendant, Apple fait la tournée des popotes sites web US en indiquant comment il est dès à présent possible de supprimer l'ensemble des enregistrements Siri stockés sur ses serveurs. Le guide sur la sécurité d'iOS rappelle en effet que « les enregistrements vocaux de l’utilisateur sont conservés pendant six mois [et qu'] une autre copie est enregistrée après six mois, sans son identifiant, afin [de] l’utiliser pour améliorer et développer Siri, et ce, pendant deux ans au total ».

Ce sont ces informations qu'il est possible de supprimer en plongeant dans les arcanes des réglages système des appareils. Bien malin celui qui trouve tout seul comment effacer ces données…

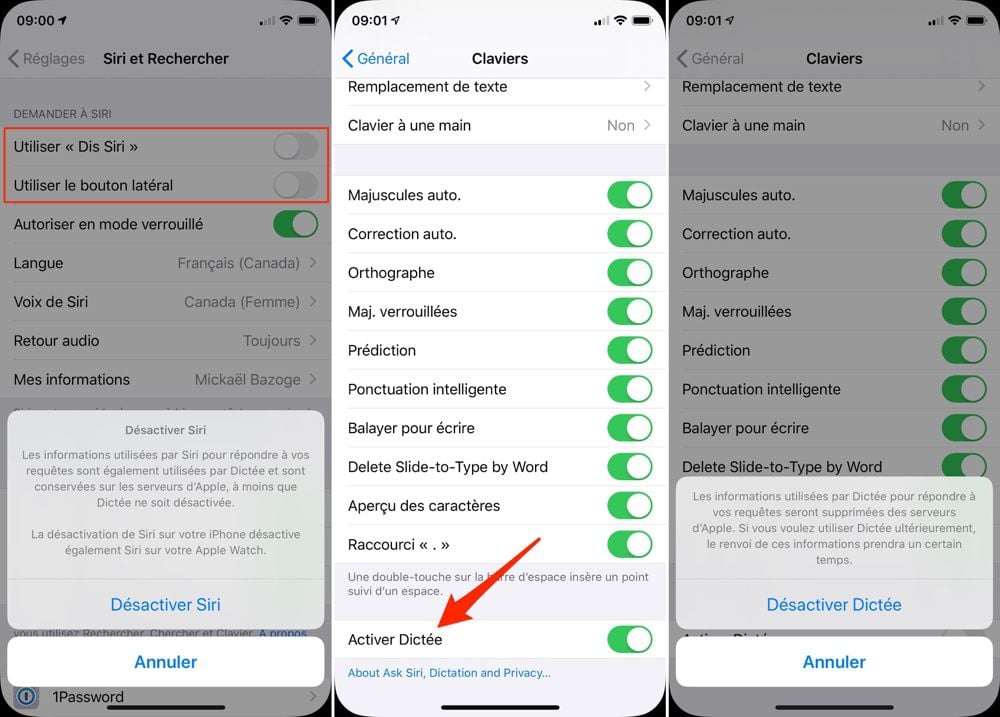

Sur iOS :

- Réglages > Siri et Rechercher : désactivez les options Utiliser « Dis Siri » et Utiliser le bouton latéral.

- Réglages > Général > Clavier : tout en bas de l'écran, désactivez l'option Activer Dictée.

Il n'y a rien à faire de spécifique pour l'Apple Watch, son réglage est lié à celui de l'iPhone. Pour le HomePod, Siri reste actif même si l'assistant est désactivé sur l'iPhone. Dans ce cas, il faut se rendre dans les réglages de l'enceinte (dans l'app Maison, puis touchez les réglages du HomePod). Désactivez les options Activer Dis Siri et Maintenir pour parler à Siri.

Sur Mac :

- Préférences système > Siri : décochez la case Activer Demander à Siri.

- Préférences système > Clavier > Dictée : cochez la case Désactivée.

Ces manipulations, qui n'ont rien de franchement évidentes, devront être réalisées pour chaque appareil macOS et iOS que l'on possède (iPhone, iPad et iPod touch), ces enregistrements n'étant pas liés à un identifiant iCloud mais à chaque appareil. De plus, en réactivant soit Siri, soit la fonction Dictée (qui peut servir), le processus de collecte des données va recommencer même s'il aura un nouvel identifiant anonymisé.

Au cas où ce ne serait pas clair, ces manipulations consistent en fait à désactiver totalement Siri. Google et Amazon permettent, eux, d'utiliser leur assistant sans le stockage des enregistrements vocaux, même s'ils poussent tous les deux à activer l'historique.

Il existe des bidouilles empêchant l'enregistrement des requêtes Siri, mais elles ne sont pas à la portée du premier venu, et elles peuvent présenter des risques pour la sécurité des appareils (lire : Astuce : désactiver l’enregistrement de vos requêtes Siri sur les serveurs d’Apple). Par ailleurs, durant le processus de configuration comme nouvel appareil, il est possible de ne pas autoriser la collecte des données Siri, rappelle AppleInsider.

Au-delà des options permettant de supprimer les données détenues par les uns et par les autres1, se pose la question plus générale de l'exploitation des données. La Silicon Valley en a pris conscience suite au lobbying d'Apple, mais il reste encore beaucoup à faire pour que les utilisateurs puissent reprendre le contrôle de leurs informations (lire : La confidentialité, nouvelle promesse ténue de la Silicon Valley).

-

Ce qui est au passage une des raisons d'être du RGPD européen à l'origine de la prise de conscience de Google et d'Apple dans ces histoires d'écoutes humaines. ↩