Le MacBook Neo se vend vraiment comme des petits pains

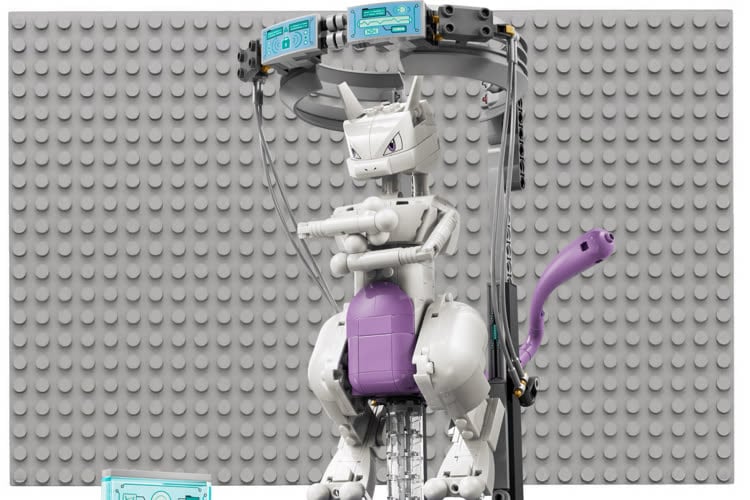

Les Pokémon en LEGO deviennent interactifs, après Star Wars et grâce à la Smart Brick

Plus de dix ans après la loi contre l'obsolescence programmée, un procès va se tenir contre Epson, un fabricant d'imprimantes

Les stations météo La Crosse avec Météo France sont bien bonnes pour la poubelle : le réseau ne reviendra pas

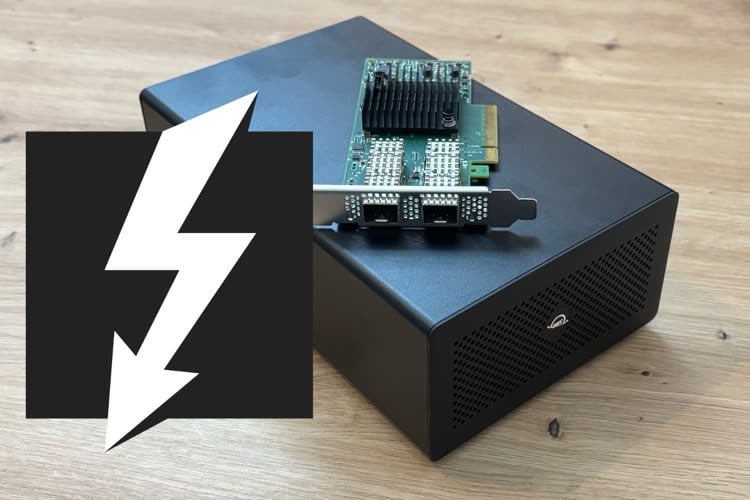

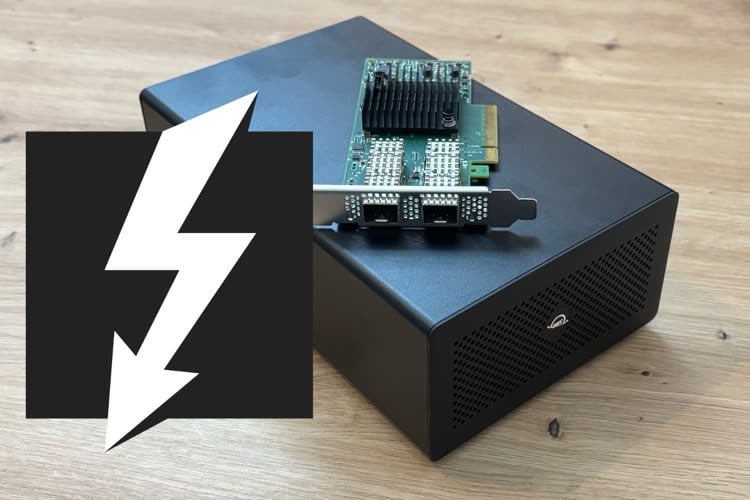

Tout savoir sur le Thunderbolt 5, notre série pour le Club iGen est maintenant complète 🆕

Promo : l’Apple Watch Series 11 de 46 mm dès 349 €, son prix le plus bas

GitHub Copilot : la facturation à l’usage fait déjà grincer des dents

Microsoft Office 2021 à vie sur votre Mac pour 44,99 € : le bon plan à ne pas laisser filer 📍

Apple distribue iOS 26.5.1, mais uniquement pour les iPhone 17 (Pro) et iPhone Air

Bon plan : le pack de 4 AirTags 2 s'affiche à son meilleur prix en France (95 €) 🆕

Le Prime Day d’Amazon fera son retour du 23 au 26 juin

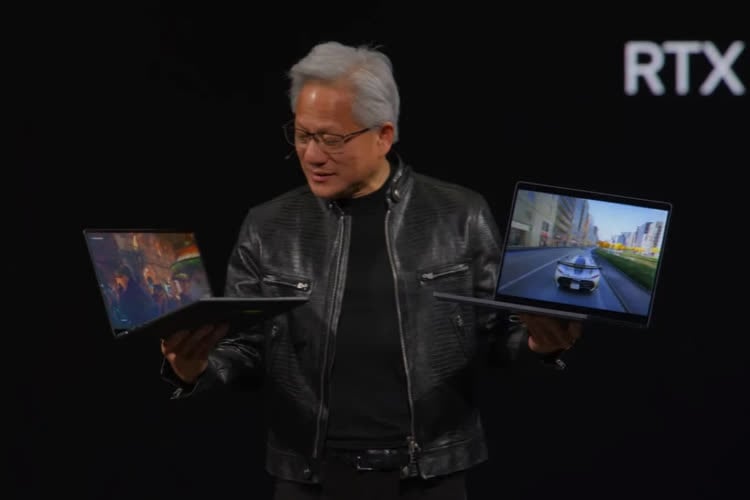

Course à la puissance : la RTX Spark peut-elle vraiment faire plier les puces d'Apple ?

Tesla : le spectaculaire rebond européen

Fonds d’écran, playlist et soirée cinéma : Apple lance les festivités avant la WWDC26 🆕

macOS 26.5.1 corrige un bug très ciblé sur les Mac M5 en entreprise

Métro et RER en Île-de-France : la carte bancaire finalement acceptée « le plus rapidement possible »

OpenAI pousse Codex au-delà du code et veut l’associer davantage à ChatGPT

02/06/2026 à 23:03

• 2

Le MacBook Neo se vend vraiment comme des petits pains

02/06/2026 à 21:28

• 37

Apple révèle les lauréats des Apple Design Awards 2026

02/06/2026 à 20:23

• 8

Phison montre un SSD PCI-Express 6.0 capable d'atteindre 28 Go/s

02/06/2026 à 19:30

• 2

Les Pokémon en LEGO deviennent interactifs, après Star Wars et grâce à la Smart Brick

02/06/2026 à 18:35

• 8

Une fuite de données du Dossier Médical Partagé revendiquée, l’Assurance Maladie penche pour une fausse alerte

02/06/2026 à 16:39

• 33

Plus de dix ans après la loi contre l'obsolescence programmée, un procès va se tenir contre Epson, un fabricant d'imprimantes

02/06/2026 à 16:30

• 35

Chrome et Google Drive abandonnent macOS Monterey

02/06/2026 à 16:07

• 6

Les stations météo La Crosse avec Météo France sont bien bonnes pour la poubelle : le réseau ne reviendra pas

02/06/2026 à 12:50

• 54

Tout savoir sur le Thunderbolt 5, notre série pour le Club iGen est maintenant complète 🆕

02/06/2026 à 12:49

• 3

Synology lance le FS200T : un NAS pour SSD… avec six baies 2,5 pouces SATA et de l'Ethernet 2,5 Gb/s

02/06/2026 à 12:05

• 39

Promo : l’Apple Watch Series 11 de 46 mm dès 349 €, son prix le plus bas

02/06/2026 à 11:39

• 1

IvyCraft - Du contenu à la création, par l'IA. Comme NotebookLM, mais pour ceux qui veulent vraiment créer

Partenaire

GitHub Copilot : la facturation à l’usage fait déjà grincer des dents

02/06/2026 à 10:34

• 23

Microsoft Office 2021 à vie sur votre Mac pour 44,99 € : le bon plan à ne pas laisser filer 📍

02/06/2026 à 10:10

• 0

Volkswagen a temporairement coupé l’accès à son API et accidentellement bloqué son app officielle 🆕

02/06/2026 à 09:59

• 19

Apple distribue iOS 26.5.1, mais uniquement pour les iPhone 17 (Pro) et iPhone Air

02/06/2026 à 09:50

• 40

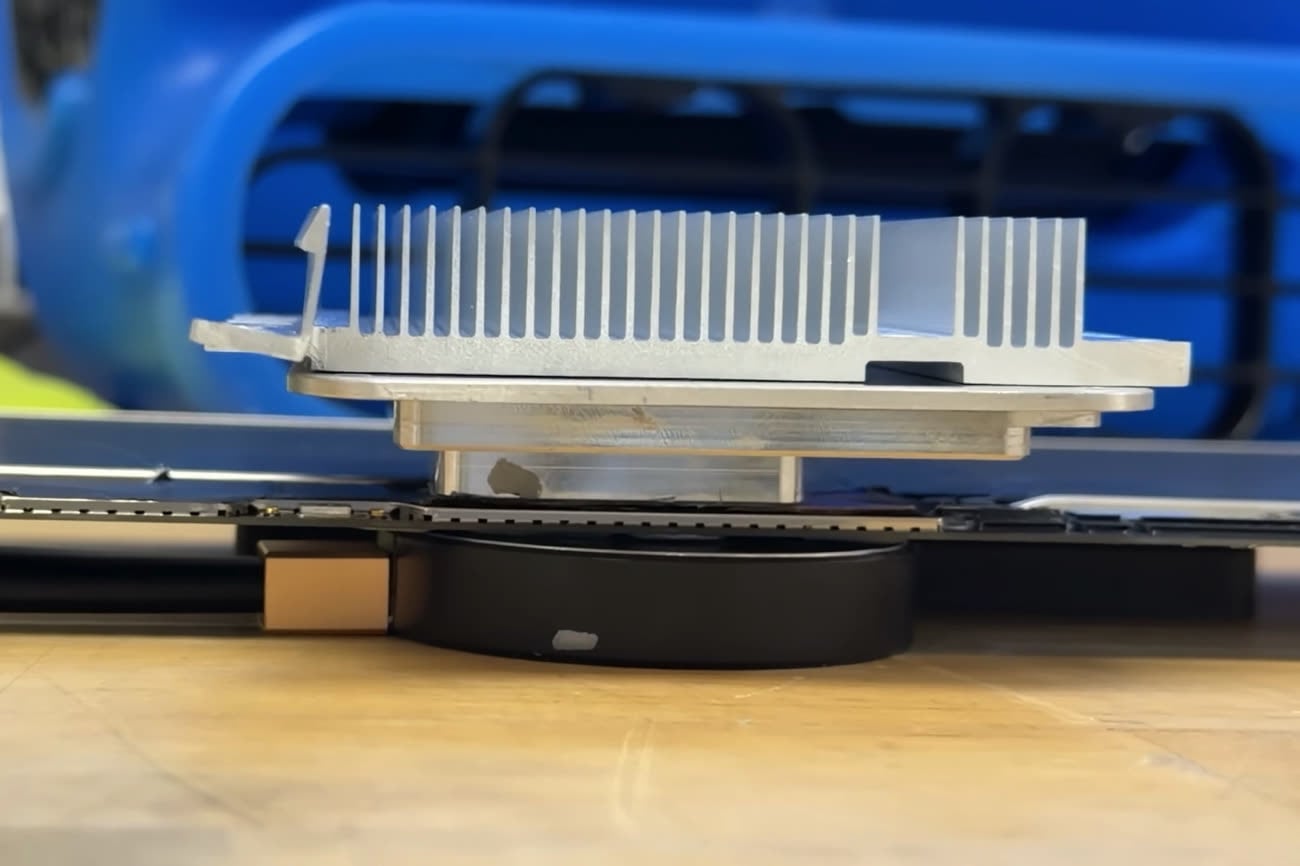

Test du Mercury Helios 5S d'OWC : le boîtier Thunderbolt 5 pour les cartes PCI-Express

Prise en main d’Iris, un catalogueur pour le Mac idéal pour (re)découvrir ses photos

Est-ce qu'Apple utilise uniquement des puces A18 Pro défectueuses dans le MacBook Neo ? Probablement pas

OpenAI : leader aujourd’hui, futur Netscape demain ?

En Thunderbolt 5, la longueur de la chaîne peut réduire très fortement les performances

Google muscle ses outils IA pour séduire les développeurs en herbe et convertir les apps iOS

CleanMyMac sous pression face à la déferlante d’apps vibe codées

Orange se prépare à commercialiser un répéteur Wi-Fi 7 pour ses clients français

Test de l’Orico X50 : un boîtier Thunderbolt 5 taillé pour les SSD très véloces

Comment l’IA est en train de forcer les verrous de la cybersécurité

Sortie de veille : les hackintosh sont condamnés, c’est la fin d’une époque

Sortie de veille : Google, un exemple à suivre pour Apple ?

Sortie de veille : les apps Mac ont-elles perdu en qualité ?

Sortie de veille : OpenAI va-t-il vraiment concurrencer l’iPhone ?

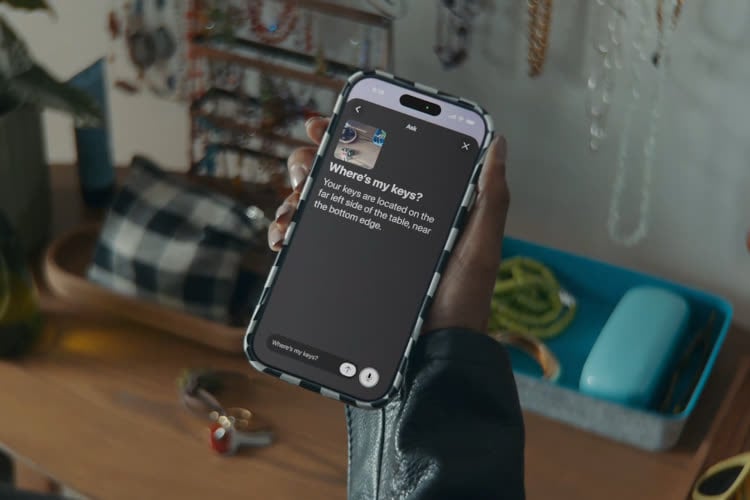

Sortie de veille : un an après son lancement, où en est Apple Intelligence ?

Sortie de veille : quel bilan pour Tim Cook à la tête d’Apple ?

Sortie de veille : quand une faille oblige Apple à prendre une mesure exceptionnelle

Sortie de veille : Apple enterre le Mac Pro, une fin vraiment inévitable ?

Sortie de veille : Apple fait-elle vraiment le max avec l’AirPods Max 2 ?

Sortie de veille : pourquoi le MacBook Neo crée la sensation

Sortie de veille : MacBook Neo, iPhone 17e… notre avis sur les nombreuses annonces d’Apple

Sortie de veille : Mac à écran tactile, iPadOS en question… les plateformes Apple à un tournant

Sortie de veille : quelles nouveautés Apple lors de l’expérience spéciale du 4 mars ?

Sortie de veille : le calvaire interminable de Siri

Sortie de veille : les MacBook Pro M5 Pro/Max en approche, quelles nouveautés attendre ?

Sortie de veille : Apple trouve le chemin du succès avant même l’AirTag 2

Fonds d’écran, playlist et soirée cinéma : Apple lance les festivités avant la WWDC26 🆕

De l’Apple Watch aux Apple Glasses, vers une nouvelle révolution ? La semaine Apple

Avec le rachat de Globalstar, Amazon récupère les parts d’Apple dans l’opérateur satellite

WWDC 26 : le dernier keynote pour Tim Cook ?

L’Apple Watch dort au sommet, les concurrents grimpent : la semaine Apple

Fermeture de l’Apple Store syndiqué de Towson : IAM appelle à la mobilisation

Apple aurait pris la tête du marché du smartphone au premier trimestre, une première

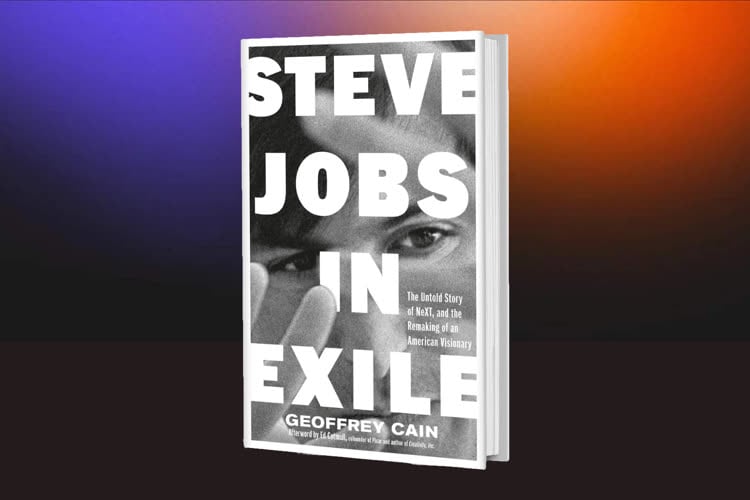

« Steve Jobs in Exile » raconte les difficiles années NeXT

Le MacBook Neo séduit les écoles américaines : 30 000 PC vont disparaître

Après sa promotion, Johny Srouji réorganise les équipes hardware d’Apple pour gagner en efficacité

Le MacBook Neo se vend vraiment comme des petits pains

Bon plan : le MacBook Air M4 avec 512 Go de stockage et 24 Go de RAM à 1 099 € (- 19 %)

Un ingénieur prouve que la puce Thread des Mac est bien active, mais toujours inutilisée

Le Mac mini M4 en stock et en promo chez Amazon

macOS 27 : c’est aussi la fin des hackintosh

MacBook Pro M6 : un filtre de confidentialité directement intégré à l'écran ?

Est-ce qu'Apple utilise uniquement des puces A18 Pro défectueuses dans le MacBook Neo ? Probablement pas

MacBook Pro M6 : la production des écrans OLED serait sur de bons rails

Promo : 30 € de moins sur le MacBook Neo 256 Go chez Amazon 🆕

Faut-il espérer de nouveaux Mac à la WWDC ?

macOS 26.5.1 corrige un bug très ciblé sur les Mac M5 en entreprise

Apple publie les premières bêtas d'iOS 26.6, macOS 26.6 et les autres

L'outil de décompression de macOS servait de vecteur dans une faille corrigée avec macOS 26.4

La solution pour « Mais c'est quoi déjà le raccourci pour les captures d'écran ? »

Apple mise sur Apple Intelligence pour améliorer l’accessibilité en 2026

L'IA Mythos Preview a permis de contourner la meilleure protection matérielle d'Apple, le MIE des puces M5

Attention aux autorisations de macOS si vous avez de la domotique et un autre navigateur que Safari

macOS 26.5 arrive en version finale, avec une petite nouveauté 🆕

Sept ans plus tard, SwiftUI n’arrive toujours pas à servir des apps Mac pur jus

WhatCable donne des informations sur les prises USB de votre Mac

Phison montre un SSD PCI-Express 6.0 capable d'atteindre 28 Go/s

Tout savoir sur le Thunderbolt 5, notre série pour le Club iGen est maintenant complète 🆕

Synology lance le FS200T : un NAS pour SSD… avec six baies 2,5 pouces SATA et de l'Ethernet 2,5 Gb/s

Sony lance son stick arcade et un écran de 27 pouces 1440p 240 Hz avec un support pour manette intégré, annoncé compatible Mac

Des claviers mécaniques aux couleurs du MacBook Neo en précommande

Le kit clavier/souris Dell avec supercondensateur est disponible en France

Test du Mercury Helios 5S d'OWC : le boîtier Thunderbolt 5 pour les cartes PCI-Express

TP-Link : les premiers routeurs Wi-Fi 8 en vente dès cet automne

Promo : le câble USB-C vers MagSafe 3 pour les MacBook à 43 €, son prix le plus bas

Acer veut concurrencer le MacBook Neo avec le Swift Air 14, un PC Windows avec 8 Go de RAM

Microsoft Office 2021 à vie sur votre Mac pour 44,99 € : le bon plan à ne pas laisser filer 📍

BenQ PD2730S vs Apple Studio Display : le match des 5K à 27 pouces 📍

Proton Mail garde un œil sur Gmail pour aider les indécis à changer de messagerie

Dropbox : 17 ans plus tard, Steve Jobs avait-il raison ?

Last.fm quitte Paramount et reprend son indépendance

Starlink préparerait une antenne Starlink Mini avec une batterie intégrée

Free veut se débarrasser des abonnés ADSL non dégroupés, poussés vers la sortie si la fibre n'est pas disponible

Après avoir réduit les fonctions de ses abonnements, Starlink augmente ses prix de 5 € par mois

Free tente de draguer les abonnés qui ont encore une Freebox v5 ou Crystal, avec une réduction sur la Freebox Pop

Boostez les performances de votre Mac avec MS Office 2021 à vie pour seulement 44,99 € 📍

De ChatGPT Plus à Claude Pro : l’herbe est-elle vraiment plus orange ailleurs ?

Cinq ans avec un MacBook Air M1 : cinq ans de bonheur

« Digital detox » : le bilan de mes vacances (presque) sans iPhone

« F1 » vrombissant à la WWDC : quand Tim Cook préfère faire son cinéma pour un film plutôt que pour ses technologies

Avec Apple Intelligence, revoilà les vieux démons du « Grand Tout »

L’iPhone est-il devenu ennuyeux ?

Régulation des Big Tech : la triste capitulation de la Commission européenne

Pour un retour aux keynotes Apple en live… ou pas

Apple aurait-elle dû racheter Red Digital Cinema ?