Oups : l’app officielle de ChatGPT n’est pas sandboxée et stocke les conversations en clair

Au mois de mai, OpenAI a lancé une véritable application ChatGPT pour macOS permettant de rapidement invoquer l’assistant ou encore de facilement lui envoyer des fichiers. La partie sécurité a visiblement été pensée à la va-vite : un développeur a remarqué que l’app n’était pas sandboxée et que toutes les conversations étaient stockées en clair sur la machine.

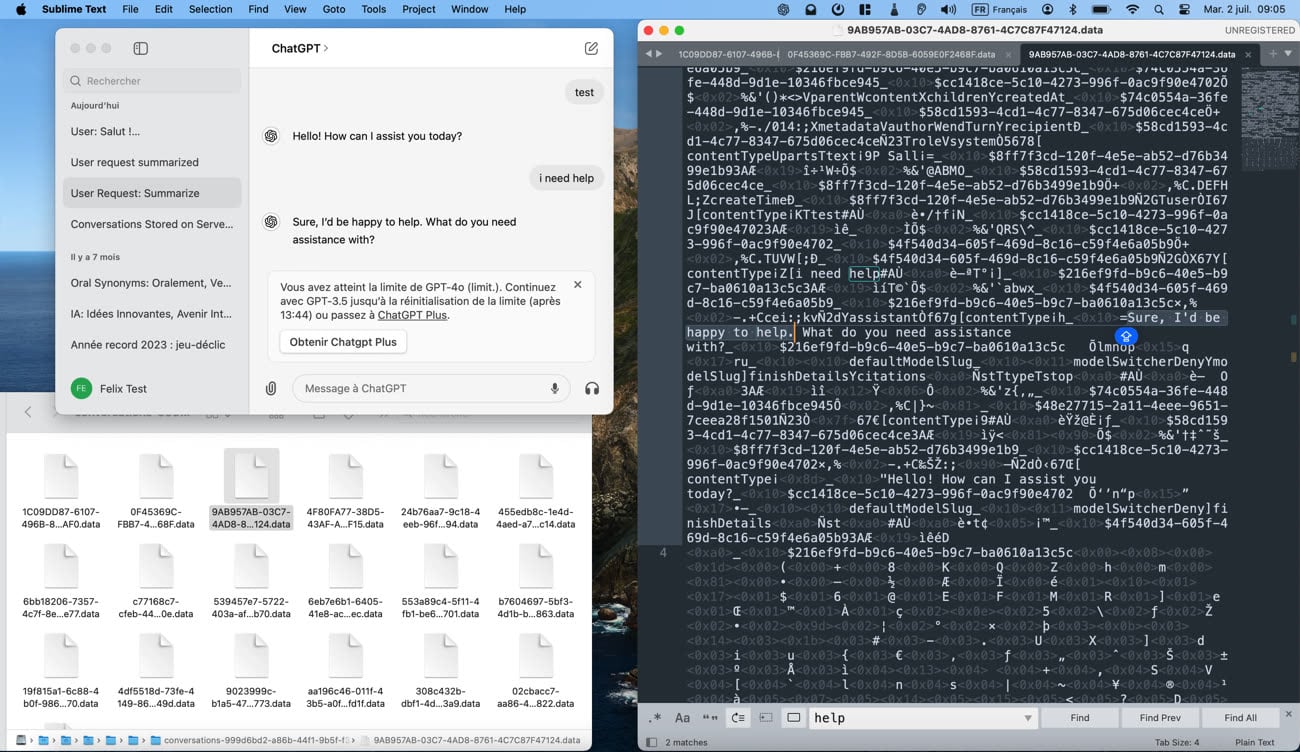

Les conversations sont en effet enregistrées dans le dossier ~/Library/Application Support/com.openai.chat au format .data. Si les discussions ne sont pas lisibles facilement en ouvrant le fichier dans un traitement de texte, les différends « prompt » sont bien trouvables en clair au milieu de caractères en vrac. Le dossier où tout cela est enregistré n’est pas sécurisé, ce qui fait que n’importe quel logiciel malveillant peut y avoir accès sans avoir à demander la permission de l’utilisateur. Il n’est pas très compliqué de monter un petit programme permettant d’extraire les conversations, comme l’a montré le développeur Pedro José Pereira Vieito sur Mastodon.

Dans son post, il précise qu’Apple a bloqué l’accès aux données privées de l’utilisateur depuis macOS Mojave 10.14, sorti il y a maintenant 6 ans. Toute application cherchant l’accès aux données privées (Calendrier, Contact, Mail…) doit demander un accès explicite. « OpenAI a choisi de ne pas utiliser la sandbox et de stocker les conversations en clair dans un emplacement non protégé, désactivant ainsi toutes ces sécurités intégrées », ajoute-t-il. L’app ChatGPT est disponible sur les Mac Apple Silicon et peut être téléchargée depuis le site d’OpenAI.

Une mise à jour bientôt vous pensez pour réglé ce problème ? Ça le fait pas avant la collaboration future OpenAI / Apple Intelligence

@Félix Cattafesta,

Au joli mois de mai, OpenAI fait ce qui lui plaît !

😁

« La partie sécurité a visiblement été pensée à la va-vite »

Le code de l'application a été généré par ChatGPT lui-même ! Encore un accident Industriel…

😁

Pendant que l'on parle d'accident industriel, nous avons aussi une catastrophe industrielle !

CVE-2024-38366 avec un score CVSS de 10 !

🏆🏆🏆

3 millions d'applications iOS et macOS impactées.

Au moins 1 milliard d'équipements Apple concernés.

https://www.clubic.com/actualite-531342-des-vulnerabilites-passees-sous-le-radar-pendant-10-ans-menacent-plus-de-3-millions-d-apps-ios-et-macos.html

😭🏆

Il y a le plus souvent une cohérence d'ensemble sur l'approche de la sécurité.

Rassurant sur le reste non ? 😳🤔

Les développeurs d’openAI auraient du demander à ChatGPT comment sandboxée leur app 😬

@nova313

😂😂😂

@nova313

Ils n’ont pas eu confiance 😱

🤪

Le contenu de mes emails ou de toute sorte de documents est tout autant accessible à une personne ayant accès à mon compte utilisateur avec un simple éditeur de texte.

Ce qui est important et que ces conversations soient sécurisées cryptographiquepent lors des échanges par Internet avec les serveurs d’Open.AI.

Je ne vois pas l’intérêt de protéger le contenu généré par une application de l’accès par d’autres applications, tant qu’elle sont exécutées par l’utilisateur propriétaire des données.

Au contraire, cela m’embêterait d’être obligé d’ouvrir l’app ChatGPT pour accéder à ce contenu lorsque je souhaiterais l’exploiter dans des scripts bash ou des petits bouts de code python en local par exemple.

@Brice21

Et si une application que vous avez installé, en laquelle vous avez confiance, par exemple chrome 😉, se met à scanner les données de chat-gpt qui sont en clair ?

De ce que je comprends, si chat-gpt était sandboxée, il faudrait que chrome demande spécifiquement l’accès à ces données, ce que vous refuseriez.

Sinon, peut importe que la connexion réseau soit cryptée ou non, les données ont déjà été siphonnées à la source.

@amonbophis

Punaise je viens de comprendre le pseudo amonbophis pour la première fois :-) bien joué.

@AirLink

C’est un architecte égyptien de renommée internationale ! (C’est bon ? J’ai toucomprix ? 🙃)

@Camousse

Ah mince grillé 👍

@AirLink

La réf est dans Astérix et Cléopatre..

@amonbophis

Chrome étant littéralement un spyware de Google qui espionne tout notre trafic web pour nous profiler, si je lui faisais confiance, son accès aux logs de l’application Mac de ChatGPT ne serait qu’un détail de l’histoire ;-)

Mais j’ai compris l’intérêt du « sandboxing », surtout pour les applications bancaires, les gestionnaires de mots de passe, de notes confidentielles, etc.

J’observe cependant qu’énormément d’applications ne sont pas « sandboxées » et laissent l’accès à leur données et leurs documents aux applications tierces. À commencer par Apple Mail, Office, Adobe Creative Cloud, etc.

@Brice21

Oui, on est d’accord.

Je pense qu’il aurait été plus intéressant que macg nous pondent un article plus général sur les évolutions de la sécurité des app.

Mais ça ça ne me choque pas, je ne comprends pas cet article qui part vite en besogne et nous en parle comme si c’était évident.

@ anton96

> ça ça ne me choque pas, , je ne comprends pas cet article...

Je vous conseille de lire le commentaire de amonbophis envoyé deux minutes juste avant le votre et qui n'était probablement pas encore affiché quand vous avez écrit le vôtre. Il explique bien pourquoi vous devriez être "choqué".

@Brice21

Ce n’est pas parce beaucoup d’applications sont des passoires que toutes doivent l’être.

Si vous ne voyez pas le problème il y a plusieurs possibilités :

- vous ne travaillez pas dans la sécurité informatique ;

- votre métier n’est pas de trouver coute que coute un moyen de récupérer des données utilisateurs ;

- ou tout simplement vous n’avez peut être pas assez d’imagination.

@MGA

Je choisir l’option 2.

@Brice21

👍 professionnellement ce sont des vicieux sans limites, peut être qu’il y en a ici d’ailleurs malheureusement je doute qu’ils aient la possibilité ou le droit de nous donner des anecdotes croustillantes…

@Brice21

« Le contenu de mes emails ou de toute sorte de documents est tout autant accessible à une personne ayant accès à mon compte utilisateur avec un simple éditeur de texte. »

Oui, mais ça, tu le sais et tu en as conscience.

Même si ça paraît évident, je n’avais pas réalisé que toutes mes conversations avec ChatGPT étaient stockées de façon durable dans un fichier log, en clair, avec une application non sandboxee.

Après avoir vu des techniques de hacking via ChatGPT, par exemple via des prompts masqués d’une façon ou d’une autre, ces logs clairs et en libre accès via n’importe quelle application me paraisse pour le moins malheureux.

Qu’est ce qui empêche quelqu’un de se faire envoyer l’intégralité des logs via des prompts masqués par exemple dans un mail ?

Après, c’est pas du tout mon métier ni mon domaine de compétence, je me trompe probablement, mais c’est pas hyper rassurant.

Surtout que ça n’indique pas une culture de la confidentialité chez Open AI….

@ Brice21 : « Je ne vois pas l’intérêt de protéger le contenu généré par une application de l’accès par d’autres applications, tant qu’elle sont exécutées par l’utilisateur propriétaire des données. »

Ça, c’est le modèle de sécurité à l’ancienne, où on considère que le danger vient des autres utilisateurs. Ça a du sens sur un serveur dont l’accès est partagé par plusieurs utilisateurs, mais nettement moins sur une machine personnelle mono-utilisateur.

Sur ce type de machine, en revanche, s’est développé une autre forme de menace, où les données de l’utilisateur sont ciblées par des applications exécutées par cet utilisateur, volontairement (par exemple dans le cas d’un cheval de Troie) ou involontairement (malware plus subtil). Dans un tel cas, le système de gestion des utilisateurs ne fournit pas de protection. Le modèle de sécurité a donc évolué pour être complété par des mesures visant à protéger les données de l’utilisateur de ses propres applications, en les cloisonnant et en restreignant l’accès de chaque application à ce qui est jugé nécessaire (ou ce que l’utilisateur a explicitement autorisé).

« pour accéder à ce contenu lorsque je souhaiterais l’exploiter dans des scripts bash ou des petits bouts de code python en local par exemple. »

Ça reste tout à fait possible. Il faut juste leur autoriser l’accès.

@Brice21

« Je ne vois pas l’intérêt de protéger le contenu généré par une application de l’accès par d’autres applications, tant qu’elle sont exécutées par l’utilisateur propriétaire des données. »

Disons que c’est un principe de protection venu de iOS.

@iPop

« « Je ne vois pas l’intérêt de protéger le contenu généré par une application de l’accès par d’autres applications, tant qu’elle sont exécutées par l’utilisateur propriétaire des données. »

Disons que c’est un principe de protection venu de iOS. »

Oui, et puis c’est un gros « tant ».

Le problème, c’est justement si les applications deviennent exécutables par d’autres que le propriétaire, à coup de prompts masqués comme cela a pu être fait.

Pour l’instant, l’application semble vraiment très primaire.

J’utilise la Version 1.1.0 (20230803.134154) qui semble être la dernière et je ne peux pas déplacer sa fenêtre, seulement la redimensionner. 😳

@Mac1978

Ça fonctionne parfaitement chez moi, êtes-vous sûre d’avoir téléchargé la bonne application ou d’être sur un Mac Apple Silicone ?

Pour rappel pour télécharger l’application directement, il faut se connecter sur un navigateur, cliquez sur son nom d’utilisateur à partir de là pour être sûr 😈

@R-APPLE-R

Merci de votre post.

En principe oui. J’utilise un MBP M1Max.

Mais je me rends compte qu’étant sous Ventura, je ne peux pas utiliser la dernière version de chatGPT que je viens de re-télécharger depuis le site d’OpenAI.

Bizarre ce souci. Jamais rencontré.

La dernière version porte la référence 1.2024.170 (1719338033)

D’où l’intérêt de l’App Store.

@FloMo

👍

@ Florent Morin

> D’où l’intérêt de l’App Store.

Toutafé.

Ce qui sera intéressant, ce sera de suivre la sécurité/fiabilité des apps qui seront distribuées via des magasins tiers. Accepteront-ils des apps non sécurisées comme celle de ChatGPT ?

That is the question.

Complètement d'accord pour l'App Store.

S'ils pouvaient faire le ménage, ce serait top.

Il y a un nombre incroyable d'applis qui se référencent ChatGpt en utilisant les mêmes codes visuels. Aucune n'est officielle évidemment.

@FloMo

Absolument pas d’accord.

En tapant chatGPT-4 dans le moteur de recherche de l’AppStore sur mon MPB, j’ai environ une trentaine de chatbot proposés, mais pas l’officiel.

Idem si je précise chatGPT 4o, ou que je rajoute open ai.

@Mac1978

J’ai tapé ChatGPT comme la majorité le ferait et c’est la première app que j’ai en dessous d’une « annonce » 😉

@Krysten2001

Alors, cela signifie d’une part que vous utilisez MacOS 14.x, soit Sonoma, ou ultérieur, alors que je suis encore sous Ventura, et d’autre part que l’AppStore détecte la version de l’OS avec laquelle on se connecte. En conséquence de quoi, chatGPT n’est plus téléchargeable pour moi.

@FloMo

« D’où l’intérêt de l’App Store. »

De ce point de vue, c’est vrai.

Après, ça verrouille aussi les applications ou l’absence de sandboxing a du sens voire est indispensable, non ?

Mais oui, l’App Store c’est très bien, mais pas que.

@FloMo

Non justement, on devrait pouvoir avoir l’os qui force le sandboxing sans forcément avoir de store.

C’est justement le mélange des deux qui a pourris le débat sur les stores alternatifs.

C’est dommage que macg a fait peut de différence entre les deux. J’aime beaucoup les analyses ici d’habitude mais je pense que c’est les des sujets les plus importants et les moins bien géré par la rédaction.

@ anton96 : « Non justement, on devrait pouvoir avoir l’os qui force le sandboxing sans forcément avoir de store. »

Ben c’est possible : une application peut être configurée pour être en bac à sable sans pour autant être distribuée via l’App Store.

@anton96

« Non justement, on devrait pouvoir avoir l’os qui force le sandboxing sans forcément avoir de store. »

Heu…

Si c’est debrayable, alors.

Ça a le mérite de rappeler que rien de ce qu’on donne à ChatGPT n’est protégé ou ne doit être considéré comme confidentiel…

Mais c’est préoccupant.

Boaf, si quelqu'un veut vraiment mes données il passera par Triangle ou GoFetch qui ne sont toujours pas comblé par Apple.

Après se rendre compte qu'un ancien directeur de la NSA est au board d'OpenAi, et que c'est bien cette solution qu'Apple semble privilégier.

Encore ce satané de stagiaire 😅

@kafy28

Mais ils vont l’embaucher partout celui-là?

Je croyais que les apps étaient systématiquement sandboxées par défaut : en fait non c'est au bon vouloir du développeur si je comprends bien ?

Ahahahaahah…

Non, AHAHAHAHAHAHH

Imaginez les boìtes qui disent qu’elles ont un cloud mega super pritégee pour faire tourner les IAs et les mêmes qui jurent promis craché que vos données ne seront pas utilisées.

Bref, sans être ouvertes pour des audits, il faut être un findon ou/et un fanboy pour croire leurs salades.

Est ce que j’utilise des LLMs? Oui. Est ce que je les utilise s’ils ne tournent pas en local: Non.

@0MiguelAnge0

« Est ce que j’utilise des LLMs? Oui. Est ce que je les utilise s’ils ne tournent pas en local: Non. »

Il y en a beaucoup qui fonctionnent en local ?

Comment savoir (sauf à avoir les yeux fixés sur une application dédiée) qu’aucune requête/prompt ne sont envoyés ?

Bonjour,

Pour avoir facilement ses LLM en local : https://ollama.com/

Liste des models : https://ollama.com/library

Exemple :

Comment utiliser par exemple llama3 avec ollama ? Avec la commande : 'ollama run llama3'

Testé sous Debian, ça fonctionne parfaitement.

@thaumasson

Merci beaucoup.

Je n’imagine pas trop comment ça fonctionne uniquement en local : ça donne envie d’aller voir pour comprendre…

C’est forcément très limité, non ?

Bon, le mieux, c’est d’aller voir, merci pour le lien !