Premiere Pro va faire entrer l'IA générative de vidéos dans sa table de montage

Adobe va doter Premiere Pro de fonctions de manipulation d'image grâce à son modèle d'IA Firefly et à d'autres IA génératives de vidéos.

Aucune bêta n'est pour le moment proposée, mais ces nouveautés arriveront dans Premiere Pro plus tard dans l'année. Adobe va utiliser son IA générative Firefly — déjà employée dans la retouche de photos — pour modifier des séquences vidéo. Le clip de démonstration donne plusieurs exemples de situations ou l'IA générative vient corriger un défaut dans l'image ou en créer de nouvelles sans besoin de ressortir la caméra.

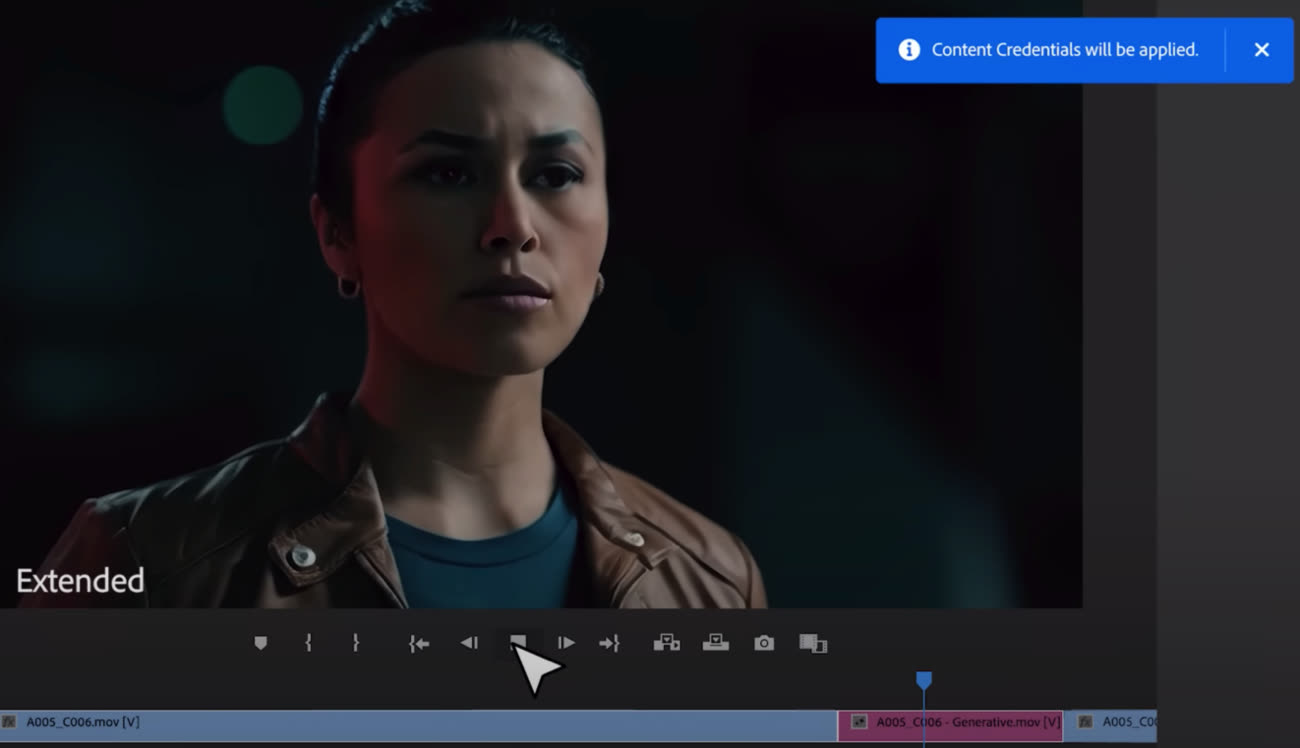

En quelques clics et en utilisant parfois quelques prompts pour expliciter ce que l'on veut, Firefly peut substituer un objet par un autre, gommer des éléments inutiles ou disgracieux dans le décor, ajouter une cravate à un acteur ou créer de nouvelles scènes d'enchainement : une vue sur un panorama sur une ville ou une séquence en voiture. Il peut être nécessaire aussi d'allonger un plan qui s'avère trop court, par exemple un gros plan sur un visage.

Les modifications montrées dans ce clip de démo sont plutôt convaincantes… lorsqu'on ne s'attarde pas trop longtemps sur les détails. L'effacement d'un bloc d'alimentation et de tuyaux sur un mur garde les traces de la gomme ; le visage généré pour allonger un gros plan sur l'actrice trahit un rendu informatique ; les compteurs dans la planche de bord de la voiture ont des chiffres et des lettres distordus, etc.

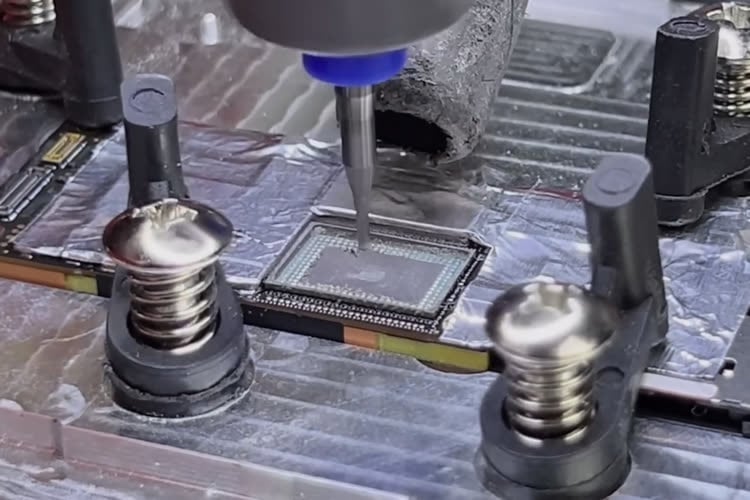

On retrouve les défauts habituels de ces modèles d'IA et certains iront sans nul doute en se réduisant. Quelques-uns des exemples proposés ont été réalisés avec des modèles de tierces parties comme Pika Labs, Runway et OpenAI dont le modèle Sora a étonné lors de la présentation il y a quelques semaines (lui aussi est encore au stade de la recherche, avec tout ce que cela implique comme bugs et faiblesses).

Sora : le générateur de vidéos d’OpenAI sera accessible au grand public plus tard cette année

C'est l'autre volet de cette présentation d'Adobe, Premiere Pro va utiliser en priorité Firefly, le modèle maison, mais l'éditeur teste l'intégration d'autres modèles pour offrir une palette plus large aux monteurs qui pourront vouloir exploiter plutôt telle ou telle IA en fonction de ses points forts.

Enfin, Adobe va utiliser son « label de provenance » numérique pour intégrer un sceau numérique — Content Credentials — sur ces images afin d'expliciter qu'elles ont été en partie créées avec une IA.

L'IA générative Firefly disponible gratuitement dans Adobe Express

Firefly, l'IA générative d'Adobe, comprend maintenant le français

On peut faire les blasés mais perso je trouve ça assez impressionant surtout le côté ultra simple. Après les temps de rendering des suggestions AI... ceux qui utilise Firefly souriront ;)

Je travaille dans la'postprod audiovisuel. Et perso je suis aussi curieux que sceptique face à ces nouveaux outils. Oui ça peut aider, mais a la marge. Je veux dire pour dépanner. Mais ça donne la dangereuse impression que tout est rattrapable en post prod ( au final c'est vrai mais a quel prix) tout en faisant une économie de moyens. Pour ce que j'en expérimente, c'est souvent contre productif et ça différé juste le problème. Je ne jette pas spécialement la pierre a adobe. Ils jouent leur partition. C'est aux professions de s'organiser. De former les personnes. il y a toute une éducation a faire sur comment implémenter ces outils. Et je ne parle pas que des plus jeunes. Au contraire. Trop souvent ça vire a la pensée magique. El famoso "on verra en post-production" a de beaux jours devant lui 😅

@Ouetham

"Mais ça donne la dangereuse impression que tout est rattrapable en post prod"

je ne sais pas pour vous mais moi j'ai l'expérience de directeur artistique et de producteur qui pensent cela depuis déjà 20 ans 😂

on appelle cela la marvelade.

les acteurs jouent en pyjama, leur permettant ainsi de refaire les costumes une fois décidés en post prod

idem pour les décors en fond vert : c'est parce que le décors n'est pas encore décidé dans le script ni au moment du tournage, ils peuvent se décider en post-prod selon le goût du moment du public.

Hollywood fonctionne déjà avec une logique de "ça se répare/décide plus tard".

sur ce je vous laisse, j'ai le nouveau remontage/correction/"Cette Fois Il Est Bien" du avant avant avant avant avant dernier film de Zacky Snydou à voir.

@oomu

ah ouais mais sur les Marvel ça marche bien 😜

je suis un grand fan

J’utilise un peu la génération de contenu de Photoshop sur des illustrations. Typiquement, pour ajouter du fond perdu sur des illustrations fournies par des clients destinées à des docs imprimés, clients qui n’ont pas prévu de marge pour leurs illus pleine page et ne veulent pas toucher au cadrage. Et bien les résultats vont du super bluffant à du gros caca…

Pratique pour remplacer le tampon etc pour nettoyer des éléments indésirables dans une photo aussi mais pas miraculeux non plus…

Le problème c’est que pour le moment firefly est vraiment nul en comparaison de stable diffusion ou midjourney. C’est moche, mal exécuté, incohérent au niveau des lumières. J’ai été surpris qu’Adobe sorte une IA aussi mal abouti.

c'est ce qui se passe quand on ne s'entraine pas sur le travail volé de milliers d'artistes internationaux.

aAAAAaw...

@oomu

Si je regarde tout ce qui m’est donné de voir sur internet et que comme tout le monde ça inspire mes créations et que je les vends alors je suis un voleur ?

Mais surtout, d’où tenez vous l’information qu’Adobe n’aurait utilisé que des images libres de droit ou achetées légalement pour l’apprentissage de son modèle ?

C’est peut être le cas mais je n’ai vu ça indiqué nulle part.

J’espère qu’il sera possible de flouter automatiquement les visages.

C’est une fonctionnalité que j’étais surpris de ne pas trouver quand j’ai testé première pro.

Adobe devrait avant s'interesser à optimiser ses logiciels ...

Jusqu'au moment où même ta boite de céréales favorite annoncera en avoir dans le paquet ?

A peu près autant que le hype autour du metavers ?

Moi qui ai l’habitude de faire tout ça sur After Effect c’est vraiment stylé! À voir dans la pratique si ça fonctionne bien surtout sur les plans en mouvement, dans la démo c’est des plans fixes…

@paulg

+1

Par contre je comprends pas trop comment ça marche les Content credentials, il y aura toujours marqué sur l’image que c’est généré par IA?

@paulg

A priori oui, comme un filigrane.

pas trop tôt

je n'en pouvais plus de tous ces films ricains d'action se ressemblant tous.

sur ce, je vous laisse, j'ai monkey man à aller voir.

C’est une démo bidon d’une vison et de son UX, on n’y est pas encore…

J’attend de voir la vitesse de génération, la qualité, la cohérence et les tarifs.

A propos, puisque c'est le NAB à Las Vegas, quoi de neuf concernant Final Cut Pro ?

J'ai vu que BlackMagic a dégainé son Davinci Resolve 19 dont la beta est disponible.

https://www.blackmagicdesign.com/fr/products/davinciresolve/whatsnew

Et ils ont une nouvelle caméra au format Box customisable, la Pyxis 6K, qui devrait se vendre comme des petits pains (à partir de 2 725 €).

https://www.blackmagicdesign.com/fr/products/blackmagicpyxis

@Mike Mac,

👍

J'en ai profité pour télécharger Davinci Resolve 19 Beta !

👌

Je ne comprends rien à leur workflow ...

On va faire de la post-prod sur des plans étalonnés et déjà montés ?

On va rallonger des plans et pour l'audio, on aura aussi moyen de rallonger le sound design, les dialogues, le mix son et les arrière-plans ? Parce que sinon, comment dire...

Et dans la démo, suis-je le seul à trouver le rendu très moche et trop lissé ?

.DR.